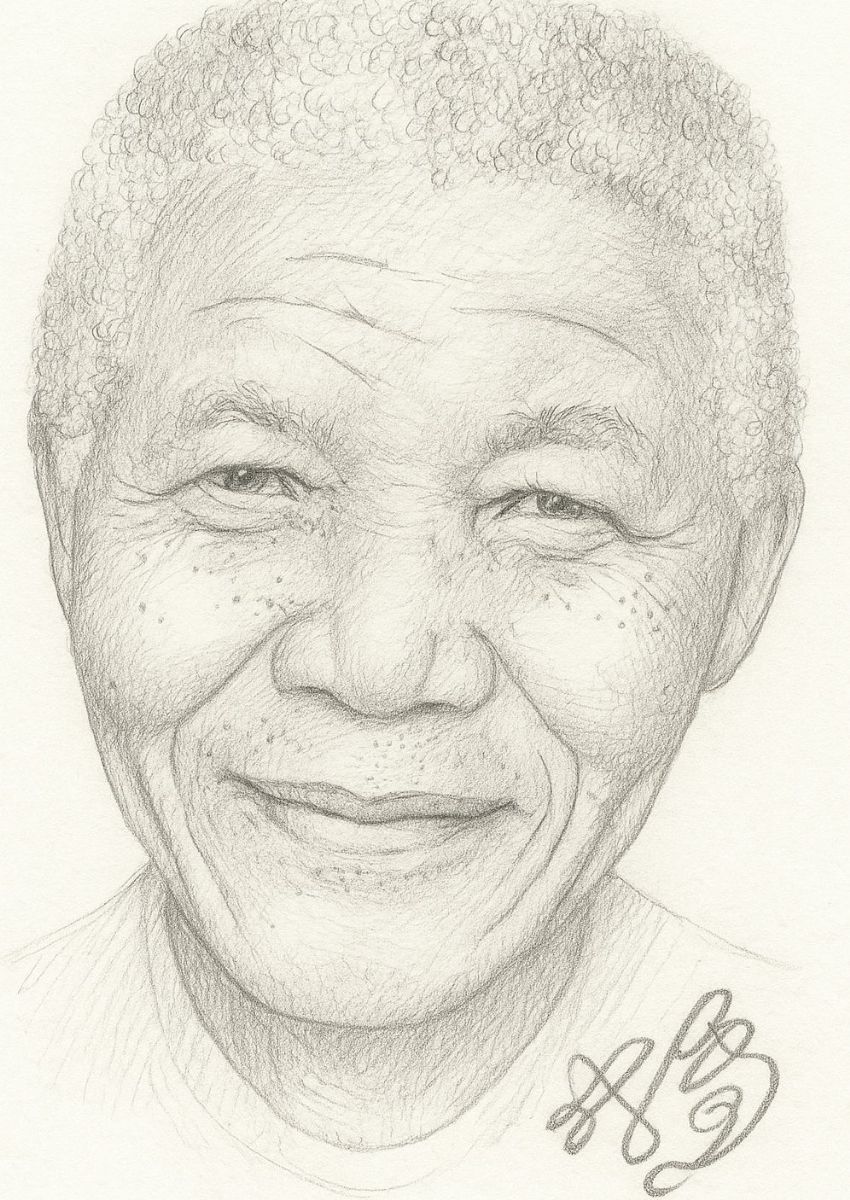

許多人第一次聽說曼德拉(Nelson Mandela,1918~2013)當選總統時,都會錯愕地說:「我清楚記得他在獄中去世的新聞畫面。」這種大規模的錯誤記憶,被稱為「曼德拉效應」(Mandela Effect)。

它說明人類記憶不是錄影帶,而是每次回想時都在重建的神經活動。當微小誤差透過媒體傳播並被群體強化,最終可能凝固為堅信不疑的「事實」。

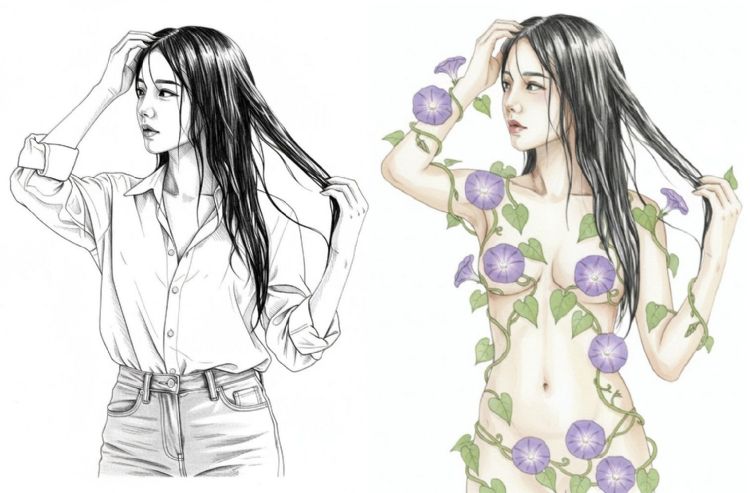

生成式AI的出現,讓這個現象進入危險的新階段。過去的錯誤記憶源於人腦的模糊回想,如今卻可能來自精心製作的數位幻象。AI能輕易生成高度擬真的內容,例如「C-3PO全銀色劇照」或「皮卡丘黑色尾巴百科條目」。這些虛構細節真實得足以欺騙未經查證的觀者,一旦在社群媒體病毒式擴散,說服力遠超過去的謠言。

更可怕的是,AI生成的不只是單一圖片或文字,而是包含照片、影片與文章的完整「證據鏈」,讓虛假記憶看似天衣無縫。

同時,AI內容正以驚人速度污染資訊生態。當人們試圖驗證記憶時,搜尋結果往往充斥大量口徑一致的錯誤答案,形成資訊迴音室。社群演算法又偏好新奇與爭議性內容,AI製造的謠言正符合這些條件,於是錯誤訊息在推送與點擊間不斷循環,甚至被推升至主流討論。

更令人憂心的是,AI不僅能放大既有錯誤,還能憑空創造從未存在的記憶。想像有人利用AI虛構一個九〇年代的卡通角色,生成動畫片段、廣告影像與週邊商品照片,再編造討論貼文。這些充滿懷舊元素的內容迅速走紅,10年後,當年的孩童已成年,腦中仍保留模糊印象。當有人發問「你還記得這個卡通嗎?」便會有大批網友響應,甚至補充劇情細節。

一個根本不存在的角色,竟成為集體的童年回憶。

此時,AI已不是錯誤的放大器,而是記憶的原始編造者,繞過既有事實,直接向集體意識注入從未發生過的過去。

這絕非單純趣聞,而是深具社會風險的徵兆。當偽造記憶結合擬真圖像、詳盡文本和龐大社群互動,真實與虛構的邊界將愈加模糊。它可能動搖人們對歷史的理解,使司法證據效力大打折扣,甚至撼動政治共識。如果某個重大事件被AI大規模改寫,數百萬人因而誤解,後果難以想像。更極端的情境是,當AI生成的虛假內容數量超過真實資訊時,搜尋引擎甚至可能將錯誤答案置於前列。此時,真相反而成了需要額外努力證明的「少數說法」,我們將進入一個「真相倒置」的時代。

因此,社會必須建立數位免疫系統。技術上需要更精準的檢測工具,辨識內容是否為AI生成。制度上,平台應透明標註AI內容,並對惡意散布者設立規範;教育上,更需強化數位素養,培養理解演算法運作的能力,養成交叉驗證與批判思考的習慣。

在個人層面,每位使用者都應保持警覺。我們必須追溯訊息來源,不輕信單一說法,也不要因「眾人皆信」就放下懷疑。面對任何看似「眾所周知」的資訊,都應該問3個問題:來源是什麼?是否有可靠第三方驗證?是否符合基本邏輯與常識?

AI的曼德拉效應提醒我們,過去不再是堅固不動的參考點,而是隨著數位技術持續被改寫的場域。在這個由演算法與幻象交織的記憶迷宮裡,真相的價值從未如此珍貴。當記憶本身都能被製造,守護真實便成為每個人的責任,而我們的選擇,將決定未來世代如何理解過去、認識現在。