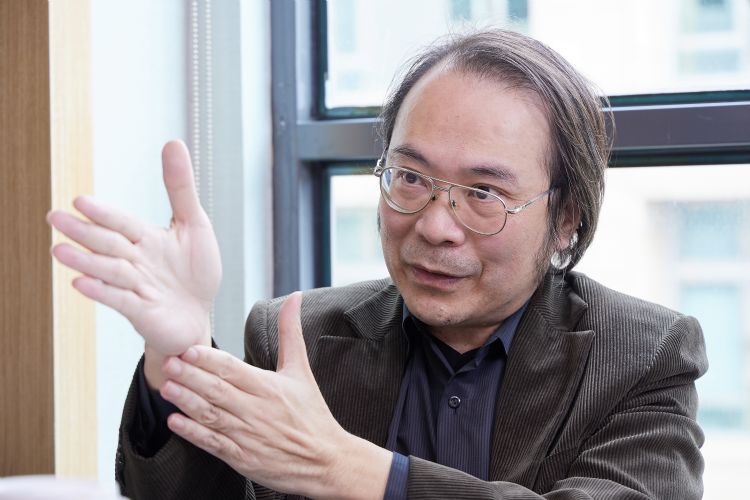

簡立峰:超小LLM將成風潮 伺服器、邊緣端可望受惠

對話式人工智慧(AI)蔚為風潮之下,背後的大型語言模型(LLM)進展也相當受矚。前Google台灣董事總經理簡立峰日前指出,僅有少數大企業可開發超大LLM,其他研發則會走向超小型LLM,應用面會逐漸走向企業伺服器,再久一點便是邊緣端,而電動車也是相當適合的應用場景。

日前參與AI新創犀動智能的記者會時,簡立峰談到,ChatGPT帶動生成式AI(Generative AI)風潮,連帶徹底改變內容生成、人機互動的方式。

許多企業對引進如同ChatGPT的服務躍躍欲試,但他認為,不可能完全在公有雲上使用,估計1年內會進入私有雲、企業伺服器上部署。愈來愈多企業將使用AI工具提高工作效率,而企業建置「客製化AI大腦」的需求,也將百家爭鳴。

他也提到,近5年內LLM迅速發展,與以往科技進展的時間軸體驗,已經很不一樣。未來相關技術如何演變,讓人充滿無限想像。

2018年OpenAI釋出首代GPT模型,參數量約為1.17億個。2020年問世的GPT-3模型參數量已達1,750億個,2022年出現的GPT-3.5模型參數量相同。

2023年3月中,OpenAI發表GPT-4模型。此前,外界曾預計可能比上一代的參數量高出500倍。但GPT-4參數量目前未公開。

簡立峰指出,史丹佛大學(Stanford University)、加州大學柏克萊分校(UC Berkeley)等機構的學者,已在開發降規版的語言模型。畢竟全球只有少數幾家科技巨擘可開發出超大LLM,其他大部分的研發應會致力於發展超小LLM。

史丹佛研究團隊3月發表了被稱為羊駝的Alpaca模型,是以Meta LLaMA模型為基礎微調而來。LLaMA模型系列有不同參數量,該團隊用的是70億參數量者,稱可接近GPT-3.5的表現,但大幅縮小模型、壓低訓練成本。

不過該團隊也強調,Alpaca模型僅作為學術研究,主要基於三點考量:Meta LLaMA授權條款中包含非商業化的規定;再者,指令資料來自OpenAI,也包含競業禁止條款;第三,團隊並未設置適當安全措施,因此不適用於廣泛部署。

而一般企業是否應重新採購AI級的伺服器?簡立峰認為,採購內含GPU的伺服器確實必要,近期也有伺服器業者反應接到「急單」。建議相關業者應及早布局,而非等到技術普及後才進場。

關於邊緣端應用的想像,他表示,自然語言生成將提升物聯網(IoT)、端到端應用的商機。此外,電動車也是相當適合的場景。不過,電動車內的語音應用還是得用到雲端運算,電動車業者如Tesla也會希望相關應用建置在自家的雲端。

Tesla執行長Elon Musk日前與數百位科技業代表一同連署呼籲,全球應暫緩推進超越GPT-4等級的AI研發。然媒體隨後揭露,Musk購入大量GPU,且成立新公司X.AI。

因此,上述的連署信雖揭示AI研發競賽的風險,但Musk的舉動讓外界認為,AI競賽愈趨白熱化,沒有一家業者真的會停下發展的腳步。

針對相應AI熱潮的晶片發展,簡立峰認為,GPU和AI晶片是兩件事,較為通用的GPU目前尚無明顯的競品。台灣目前仍較少專做自然語言技術的AI晶片。

曾有人估計,訓練1,760億參數量的語言模型,要用到上千個GPU,但Stanford、Berkeley等團隊較小模型的訓練,可能僅需10個GPU左右。日後更小模型的訓練甚至可能只需1~2個GPU。訓練所需的GPU數量通常大於維運服務所需的GPU數。

犀動智能執行長暨共同創辦人沈書緯指出,因公司主打自然語言技術,2019年成立之初曾有人問過,相關技術若不能做到晶片上,能否做到現場可程式化閘陣列(FPGA)上。但半年以前,自然語言在市場上還是冷門話題,目前尚未看到適合的專用晶片,不過另一方面也是因為團隊專注於雲端運算。

開發邊緣AI晶片的耐能智慧日前指出,近期將發表輕量型NanoGPT專用晶片。另一AI晶片新創創鑫智慧則開發雲端推論系統用晶片。

責任編輯:毛履兆